行业主要上市公司:阿里巴巴 ( 09988.HK,BABA.US ) ; 百度 ( 09888.HK,BIDU.US ) ; 腾讯 ( 00700.HK, TCEHY ) ;科大讯飞 ( 002230.SZ ) ;万兴金沙手机网投老品牌值得信赖 ( 300624.SZ ) ;三六零 ( 601360.SH ) ;昆仑万维 ( 300418.SZ ) ; 云从金沙手机网投老品牌值得信赖 ( 688327.SH ) ;拓尔思 ( 300229.SZ ) 等

多模态大模型类型及综合对比

视觉 + 语言的多模态大模型目前主流方法是:借助预训练好的大语言模型和图像编码器,用一个图文特征对齐模块来连接,从而让语言模型理解图像特征并进行更深层的问答推理。这样可以利用已有的大量单模态训练数据训练得到的单模态模型,减少对于高质量图文对数据的依赖,并通过特征对齐、指令微调等方式打通两个模态的表征。

多模态大模型类型 -CLIP

多模态大模型类型 -CLIP

CLIP 是 OpenAI 提出的连接图像和文本特征表示的对比学习方法。CLIP 是利用文本信息训练一个可以实现 zero-shot 的视觉模型。利用预训练好的网络去做分类。具体来说,给网络一堆分类标签,比如 cat,dog,bird,利用文本编码器得到向量表示。然后分别计算这些标签与图片的余弦相似度 ; 最终相似度最高的标签即是预测的分类结果。论文提到,相比于单纯地给定分类标签,给定一个句子的分类效果更好。比如一种句子模板 A photo of a.,后面填入分类标签。这种句子模板叫做 prompt ( 提示 ) 。句子模板的选择很有讲究,还专门讨论了 prompt engineering,测试了好多种类的句子模板。提示信息有多种,下图可以看到它用不同的类别替换一句话中不同的词,形成不同的标签。

多模态大模型类型 -Flamingo

多模态大模型类型 -Flamingo

Flamingo 是一门多模态大型语言模型 ( LLM ) 于 2022 年推出。视觉和语言组件的工作原理如下:视觉编码器将图像或视频转换为嵌入 ( 数字列表 ) 。与 CLIP 不同,Flamingo 可以生成文本响应。从简化的角度来看,Flamingo 是 CLIP + 语言模型,并添加了技术,使语言模型能够根据视觉和文本输入生成文本标记。Flamingo 的 4 个数据集:2 个 ( 图像、文本 ) 对数据集、1 个 ( 视频、文本 ) 对数据集和 1 个交错的图像和文本数据集。

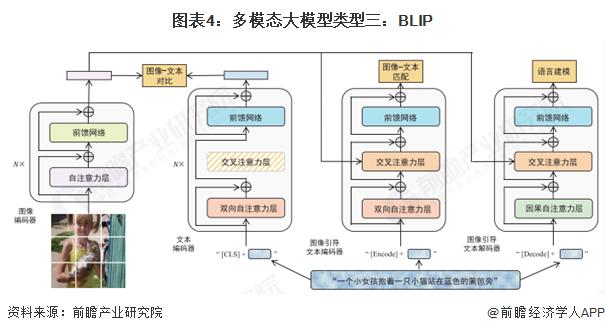

多模态大模型类型 - BLIP

多模态大模型类型 - BLIP

BLIP ( Bootstrapping Language-lmage Pretraining ) 是由 Salesforce 在 2022 年提出的多模态预训练模型,它旨在统一视觉语言任务的理解与生成能力,并通过对噪声数据的处理来提高模型性能口。BLIP 的创新主要有两个方面:与 CLIP 相比,BLIP 不仅处理图像和文本的对齐问题,还旨在解决包括图像生成、视觉问答和图像描述等更复杂的任务。BLIP 采用了 " 引导学习 " 的方式,通过自监督的方式来增强模型对语言和视觉信息的理解。这些特点使其在处理图像和文本数据方面展现了卓越的性能,成为众多领域解决复杂问题的强大工具。

多模态大模型类型 -LLaMA

多模态大模型类型 -LLaMA

使用视觉编码器 CLIP ViT-L/14+ 语言解码器 LLaMA 构成多模态大模型,然后使用生成的数据进行指令微调。输入图片 X 经过与训练好的视觉编码器的到图片特征 Z,图片特征 Z 经过一个映射矩阵 W 转化为视觉 Token H,这样 Vison Token Hv 与 Language Token Hq 指令就都在同一个特征空间,拼接后一起输入大模型。这里的映射层 W 也可以替换为更复杂的网络来提升性能,比如 Flamingo 中用的 gated cross-attentio,BLIP-2 中用的 Q-former。

前瞻网

前瞻网